過去幾年,我們談到 AI 時,更多是在討論效率、自動化與未來工作模式。但進入 2025 年後,另一個更值得警惕的現象正在快速擴大——「AI 資安犯罪」。

現在的詐騙,早已不是過去那種粗糙的釣魚簡訊。透過生成式 AI、Deepfake(深偽技術)、語音模仿、假視訊、AI 駭客工具與自動化社交工程,犯罪集團已經開始用「極低成本」大量製造真假難辨的攻擊。

更可怕的是,這些 AI 犯罪並不只發生在企業,而是正在進入每個人的日常生活:假冒親友借錢、假投資老師、AI 假客服、偽造主管聲音匯款、甚至是「看起來完全正常」的假視訊會議。

AI 時代最大的危機,也許不是 AI 太笨,而是 AI 已經「太像人」。而這篇文章,想帶你真正看懂:AI 資安犯罪正在如何改變世界,以及一般人到底該如何保護自己。

AI 資安犯罪,為什麼正在爆炸性成長?

AI 最大的特性,是它能「大規模模仿人類」。這件事原本是 AI 生產力革命的核心,但也同時成為犯罪集團最強大的武器。過去要騙一個人,需要真人客服、真人打電話、真人聊天。

現在:

- AI 可以自動生成詐騙文案

- AI 可以模仿真人語氣

- AI 可以生成假照片

- AI 可以製造假影片

- AI 可以克隆聲音

- AI 可以 24 小時自動聊天

- AI 可以同時對數萬人進行社交工程

這代表 AI 讓「詐騙產業」第一次進入真正的工業化時代。以前詐騙集團最大的限制是「人力」,現在最大的限制變成「資料量」。

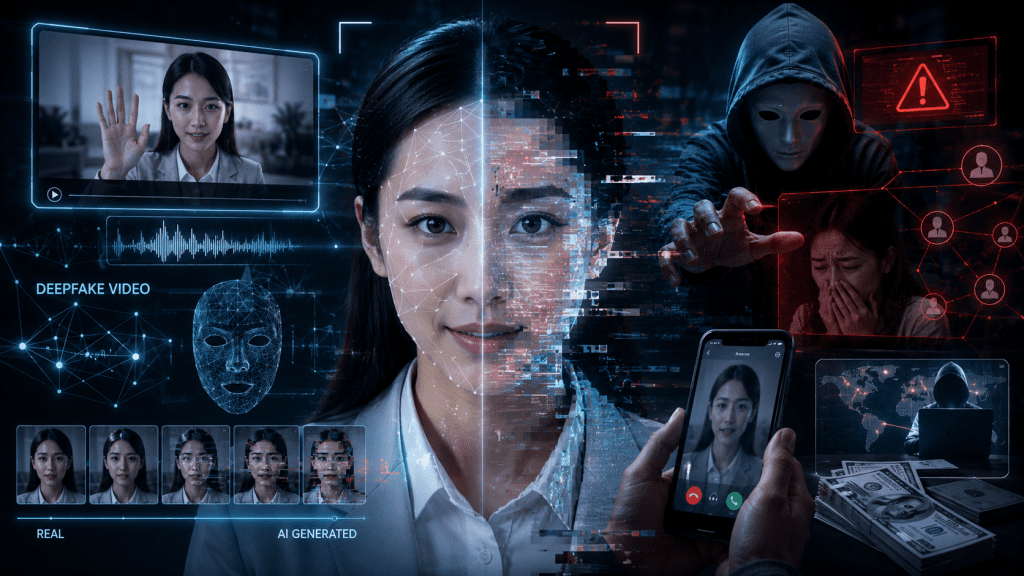

Deepfake 正在改寫 AI 詐騙世界

近兩年最危險的 AI 犯罪技術之一,就是 Deepfake。所謂 Deepfake,本質上是透過 AI 深度學習,模仿一個人的:

- 臉部

- 聲音

- 說話方式

- 表情

- 視訊動作

而且效果已經逼真到,一般人幾乎無法辨識。

最危險的,不是假影片,而是「假信任」

許多人誤以為 Deepfake 最大問題是「影片造假」。但真正可怕的是,Deepfake 正在摧毀人類最重要的社會基礎——信任。例如(常見 AI Deepfake 詐騙情境):

假冒主管要求匯款

企業財務突然收到「主管視訊」。畫面、聲音都是真的,主管要求緊急匯款,結果對方其實是 AI 偽造。2024 年香港曾發生類似案件,企業因 Deepfake 視訊會議損失超過 2,000 萬美元。

假冒親友借錢

犯罪者只需幾秒鐘語音樣本,就能模仿家人的聲音。接著打電話,「我出事了,快匯款。」很多長輩幾乎無法辨識,尤其在情緒緊張時,人腦會自動降低判斷力。

假投資老師與 AI 名人代言

現在大量假投資廣告,已開始利用 AI 生成:

- 財經名人影片

- 主播推薦

- 網紅見證

- 假新聞採訪

甚至連嘴型都能同步。這讓「影片證據」第一次開始失去可信度。

AI 詐騙已經從「亂槍打鳥」進化成「超精準攻擊」

以前的詐騙訊息通常很好辨識:

- 文法奇怪

- 中文不通

- 很像機器人

- 邏輯粗糙

但生成式 AI 出現後,一切都變了。ChatGPT 類型模型最大的能力之一,就是超擬真語言生成。現在的 AI 詐騙訊息甚至會:

- 模仿你的聊天風格

- 使用你朋友的語氣

- 研究你的社群貼文

- 分析你的興趣

- 依照你的年齡客製化內容

這代表 AI 詐騙開始進入「個人化社交工程時代」。

社交工程,才是 AI 犯罪真正的核心

很多人以為資安問題是「技術漏洞」。但實際上,超過 80% 的攻擊,最終都在攻擊「人」。而 AI 最大的危險,就是它開始大幅提升「騙人的能力」。

AI 最擅長的事:降低人的警戒心

例如:AI 假客服。你收到一則訊息:「您好,我們偵測到您的帳號異常登入。」接著 AI 客服開始與你即時對話。它回應自然、有禮貌、甚至比真人客服還專業。很多人會因此:

- 提供驗證碼

- 提供信用卡資料

- 點擊惡意連結

- 下載木馬程式

而這正是 AI 社交工程最危險的地方。它不是「強迫你」,而是讓你「自願相信」。

AI 駭客工具開始平民化

另一個危險趨勢是:AI 正在降低駭客技術門檻。以前進行網路攻擊,需要:

- 程式能力

- 滲透技術

- 資安知識

但現在,生成式 AI 已經能協助:

- 撰寫惡意程式

- 分析漏洞

- 自動生成釣魚信

- 破解社交工程腳本

- 模擬攻擊流程

雖然大型 AI 公司已開始限制違規用途,但開源模型仍大量存在。這代表未來的 AI 犯罪,不一定來自頂尖駭客,而可能來自普通人。

下一波危機:AI 自動化詐騙工廠

未來最值得警惕的,不是單一 AI 詐騙,而是「AI 自動化犯罪系統」。

例如:

- AI 自動打電話

- AI 自動聊天

- AI 自動生成假網站

- AI 自動偽造身份

- AI 自動分析受害者資料

- AI 自動優化詐騙話術

這代表犯罪集團將第一次擁有「超大規模個人化犯罪能力」。而這可能是未來 5 年全球資安最大的黑天鵝。

為什麼長輩與中小企業最危險?

AI 犯罪並不是平均攻擊所有人。目前最脆弱的兩大族群其實是:

1. 長輩族群

原因很簡單:

- 對 AI 技術不熟

- 對影音證據過度信任

- 缺乏數位辨識能力

- 情緒容易被操控

尤其「假親友求救」未來會越來越危險。因為 AI 語音克隆成本已快速下降。

2. 中小企業

許多中小企業沒有完整資安防護。但企業內部:

- 財務資料

- 客戶資料

- 匯款權限

- 帳號權限

都非常有價值。而 AI 讓「假主管攻擊」成功率開始大幅上升。

AI 時代最重要的能力:懷疑能力

未來世界最稀缺的能力,也許不是寫程式。而是「辨識真假」的能力。因為 AI 已經讓:

- 圖片不可信

- 聲音不可信

- 影片不可信

- 訊息不可信

甚至「看起來非常真」這件事,本身反而變成風險。

一般人如何防範 AI 詐騙?這 10 個習慣非常重要

1. 不要相信「聲音」本身

未來聽到家人聲音,不代表真的是本人。

若涉及:

- 匯款

- 借錢

- 緊急求救

請一定:

- 打原本電話確認

- 使用第二管道驗證

- 問只有本人知道的問題

2. 不要只靠影片判斷真偽

Deepfake 技術已經能做到高擬真。

尤其:

- 名人影片

- 財經老師

- 投資推薦

- 視訊會議

都可能是 AI 偽造。

3. 永遠不要提供驗證碼

真正的客服,通常不會主動要求:

- OTP 驗證碼

- 網銀密碼

- 信用卡完整資訊

凡是要求這些內容,高機率就是詐騙。

4. 建立「延遲判斷」習慣

AI 詐騙最喜歡利用:

- 緊急感

- 恐懼感

- 壓迫感

例如:

- 「現在立刻處理」

- 「不然帳號會被鎖」

- 「你家人出事了」

這時候最重要的不是立刻反應。而是故意停下來。因為冷靜,是對抗社交工程最強的防火牆。

5. 使用雙重驗證( MFA )

即使密碼外洩,MFA(多因素驗證)仍能大幅降低風險。

尤其:

- 網銀

- 雲端硬碟

- 社群平台

一定要開啟。

6. 不隨便上傳敏感文件給 AI

很多人已開始把:

- 身分證

- 合約

- 公司機密

- 客戶資料

直接丟進 AI 工具。但問題是,你不一定知道資料會被如何保存。企業更需要建立:

- AI 使用規範

- 機密資料分級

- AI 上傳限制

7. 注意「過度自然」的訊息

未來最危險的詐騙,不再是奇怪訊息。反而是太自然的訊息。

尤其:

- 非常有禮貌

- 回應超快

- 情緒理解很強

- 很像真人客服

反而可能是 AI。

8. 企業一定要建立 AI 資安教育

未來企業最大的漏洞,不是系統,而是員工。因此,AI 資安教育將變成企業新基本配備。

內容至少包括:

- AI 詐騙辨識

- Deepfake 風險

- 假會議辨識

- 社交工程演練

- AI 工具使用規範

9. 建立「多通道確認」制度

企業未來應建立:

- 匯款二次確認

- 視訊身份驗證

- 關鍵指令回撥機制

因為,未來「看見本人」也不一定安全。

10. 永遠記住一句話

AI 不會取代人,但會放大人的善與惡。因此,真正重要的從來不是 AI 本身。而是,人類如何使用 AI。

小編觀點

AI 資安的本質,其實是「信任危機」

很多人把 AI 犯罪當成科技問題。但我認為,它本質上其實是「社會信任危機」。過去幾十年,我們建立了一套基於:

- 聲音

- 影像

- 文件

- 對話

的信任系統。但 AI 正在讓這些證據全面失效,未來世界最大的挑戰,可能不是 AI 太強。而是人類開始不知道還能相信什麼。因此下一代最重要的能力,也許不是數位能力,而是:

- 驗證能力

- 判斷能力

- 冷靜能力

- 資訊識讀能力

AI 時代真正的資安,將不再只是防火牆。而是「人的思考能力」。

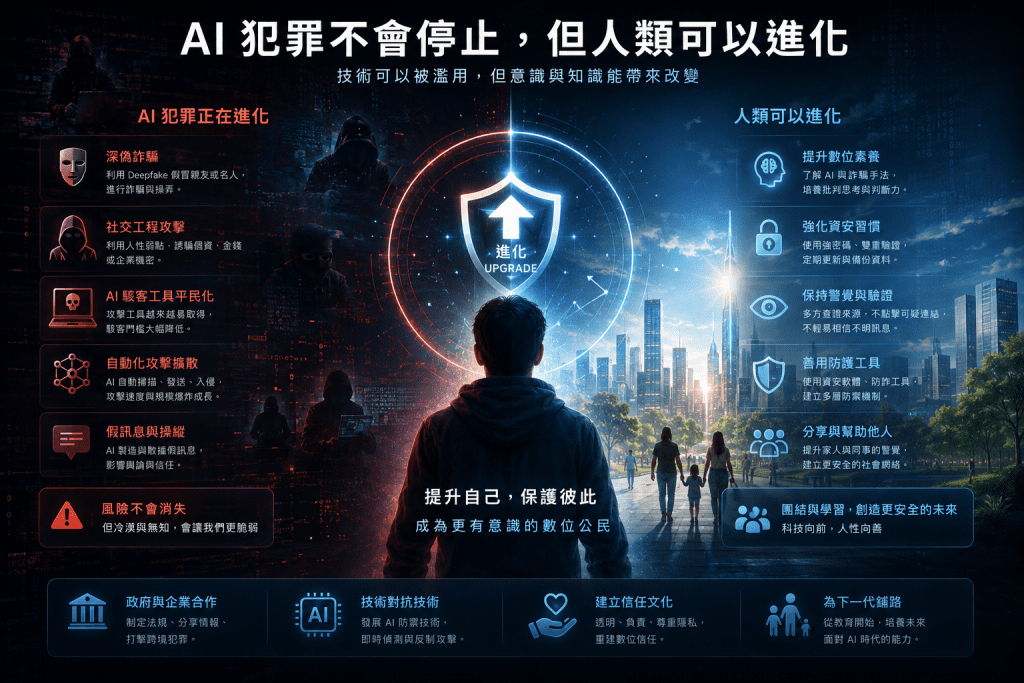

AI 犯罪不會停止,但人類可以進化

AI 詐騙與 AI 資安犯罪,未來幾乎只會越來越真、越來越快、越來越大量。但這不代表我們只能恐懼。因為每一次科技革命,本來都會同時帶來:

- 新效率

- 新風險

- 新規則

現在真正重要的,不是拒絕 AI。而是學會在 AI 時代中,更聰明地保護自己。未來最安全的人,不一定是最懂技術的人。而是最懂得「保持懷疑與驗證」的人。