當生成式 AI 開始大量進入企業、校園、政府與個人工作流程後,「便利」與「風險」其實正在同步放大。很多人以為資訊安全只是科技公司或 IT 部門需要擔心的問題,但現在真正危險的,往往是員工每天輸入的一段 Prompt、一份上傳的 Excel 檔案,甚至是一句「幫我整理這份客戶資料」。

AI 正快速改變人類的工作方式,同時也正在重寫 AI 資安規則。過去的資安防線,大多圍繞在「防止外部入侵」,但 AI 時代最大的風險,很多時候反而來自「內部使用習慣」。當人們開始過度信任 AI、忽略資料邊界、缺乏帳號治理觀念時,企業真正的漏洞,其實可能就是每天都在使用 AI 的自己。

這篇文章,帶你看懂 AI 時代資訊安全正在發生的 7 個重大變化,以及未來每個人都該建立的新防護思維。

資訊安全,已經不是 IT 部門的事情

過去談到資安,很多人第一時間想到的是:

- 防火牆

- 防毒軟體

- 駭客攻擊

- 勒索病毒

- 系統弱點

但 AI 時代最大的改變,是「每個人都可能成為資料出口」。因為生成式 AI 的本質,就是「資料交換」。你提供資料,AI 幫你處理,再回傳結果。問題是很多人根本不知道,自己輸入的內容是否適合被 AI 處理,這也是為什麼近兩年全球企業開始大量出現:

- AI 使用規範

- Prompt 管理政策

- AI 資料分級制度

- AI Governance(AI 治理)

- AI Shadow IT 管控

因為真正危險的,不再只是駭客,而是「無意識的資料暴露」。

現在越來越多企業開始發現,真正的資安風險,很多時候不是外部入侵,而是員工在沒有意識到風險的情況下,主動將客戶資料、商業內容甚至機密文件貼進 AI 工具中。

(延伸閱讀:你貼到 ChatGPT 的這 5 種東西,正在讓公司損失數億)

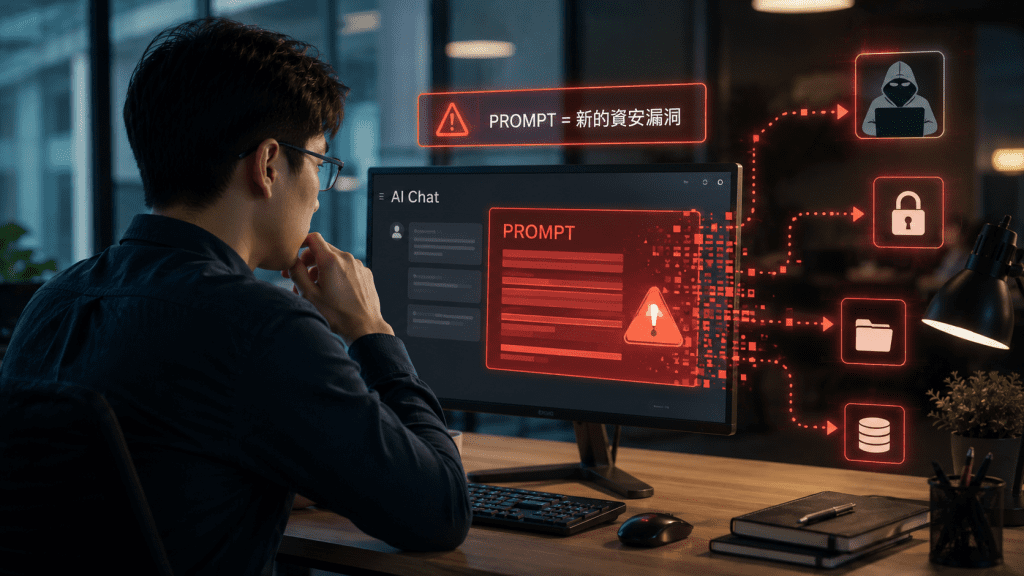

1. Prompt(提示詞)正在變成新的 AI 資安漏洞

很多人不知道:Prompt 本身就可能是機密

現在很多人習慣直接對 AI 說:

- 幫我分析這份客戶名單

- 幫我整理合約內容

- 幫我優化公司財報

- 幫我寫員工績效分析

- 幫我檢查 API 金鑰錯誤

問題是這些 Prompt 裡,往往早已包含敏感資訊。例如:

- 客戶姓名

- 電話

- 身分證字號

- 商業策略

- 未公開產品

- 程式金鑰

- 公司營運數據

很多使用者以為自己只是「問問題」,但在 AI 系統眼中,那其實是「資料輸入」。

Prompt Injection 已成 AI 時代新型攻擊

近年 AI 資安圈最熱門的詞之一,就是 Prompt Injection(提示詞注入攻擊)。簡單來說,攻擊者會故意設計惡意內容,誘導 AI 洩漏不該公開的資訊。例如:

- 誘導 AI 忽略原本規則

- 騙 AI 顯示內部設定

- 讓 AI 洩漏系統 Prompt

- 操控 AI 回覆錯誤資訊

這種攻擊之所以危險,是因為它不像傳統駭客需要高技術門檻。很多時候,只靠「語言」就能攻擊。

未來趨勢:企業開始建立 Prompt Firewall

現在越來越多大型企業,已經開始導入:

- Prompt 過濾系統

- 敏感詞偵測

- AI DLP(資料外洩防護)

- Prompt Logging(提示詞稽核)

未來企業資安的核心,不只是防駭客,而是「管理員工到底對 AI 說了什麼。」

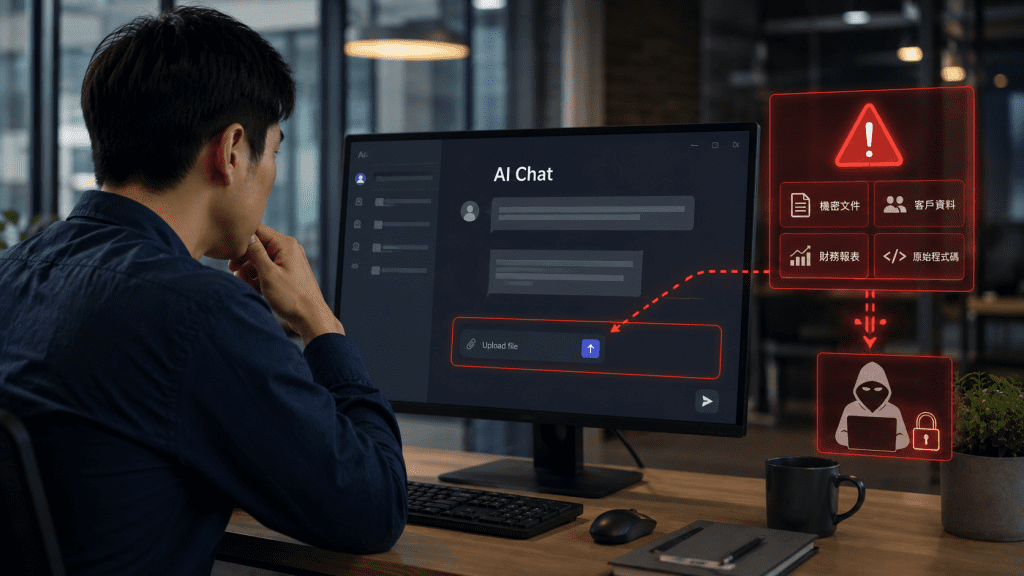

2. 上傳檔案,可能是最危險的 AI 使用習慣

很多人根本不知道哪些檔案不能上傳

這是目前最常見的 AI 資安問題之一。尤其企業員工最容易發生:

- 把客戶 Excel 丟給 AI 分析

- 上傳合約請 AI 摘要

- 丟內部會議記錄生成簡報

- 上傳原始碼請 AI Debug

- 上傳財報做預測

多人以為「只是暫時給 AI 看一下。」但問題是,你無法百分之百確定,資料後續是否被保存、記錄或再利用。

事實上,生成式 AI 的資料隱私問題,近年已逐漸成為全球監管焦點。2023 年時,義大利就曾因資料保護疑慮,暫時禁止 ChatGPT 在當地使用,後續 OpenAI 也因此更新隱私政策與資料保護機制。

(資料來源:OpenAI 更新隱私規範及加強資料保護,義大利解除 ChatGPT 禁令)

AI 時代最大的錯覺:以為免費工具沒有代價

很多免費 AI 工具,其實真正的商業模式就是「資料換服務。」這也是近年全球企業開始禁止員工隨意使用外部 AI 工具的重要原因。2023 年後,許多國際企業陸續限制:

- 員工使用公共 AI

- 上傳內部文件

- 使用未審核 AI 平台

因為一旦資料外流,損失的不只是檔案,而是整個商業信任。

未來企業會開始建立「AI 資料分級制度」

未來企業最重要的新能力之一,就是「哪些資料可以給 AI?」企業將逐漸建立:

| 資料類型 | 是否可上傳 AI |

|---|---|

| 公開行銷文案 | 可 |

| 一般教育資料 | 可 |

| 客戶個資 | 不可 |

| 財務報表 | 高限制 |

| 原始碼 | 高限制 |

| 研發文件 | 禁止 |

| 合約文件 | 條件限制 |

未來真正成熟的企業,不會禁止 AI,而是建立「資料邊界」。

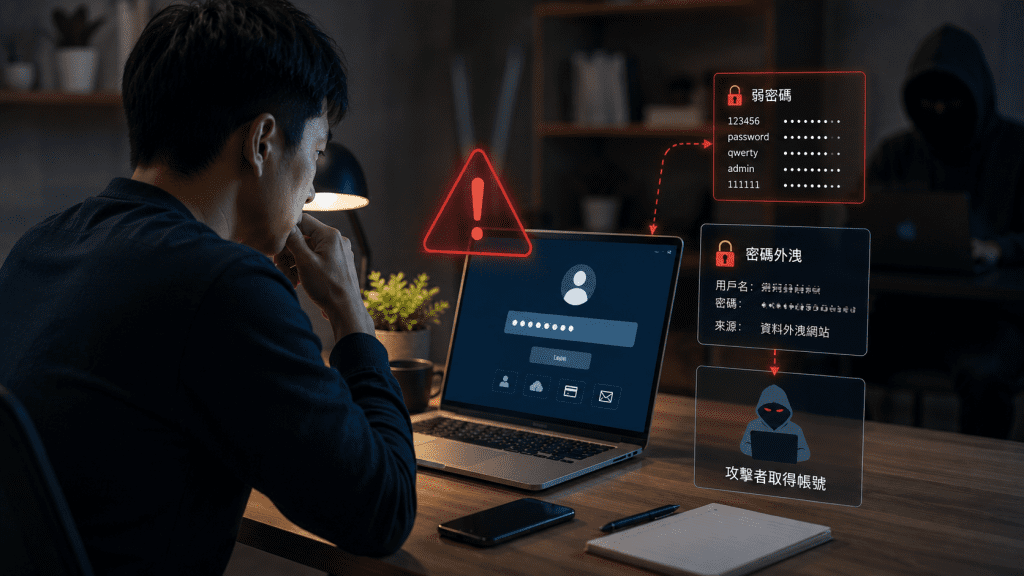

3. AI 時代,帳號密碼管理反而更危險

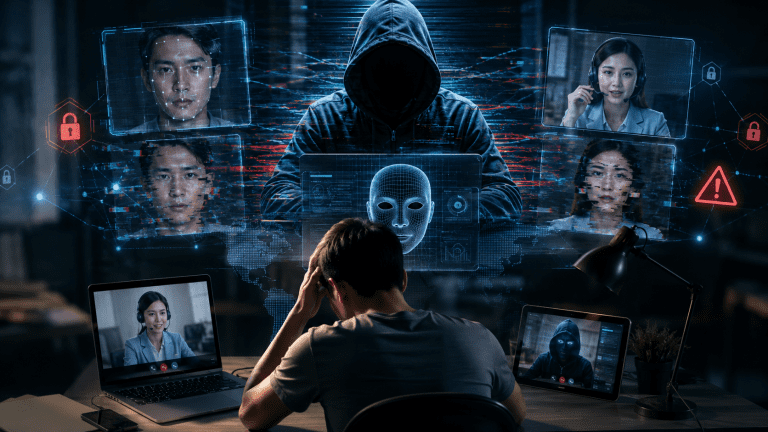

AI 正在讓社交工程攻擊變得更真實

以前詐騙信很多都很假。但現在 AI 可以做到:

- 超自然語氣

- 模仿主管口吻

- 偽造客服對話

- 生成高可信 Email

- 模擬真人聊天

這讓 phishing(釣魚攻擊)成功率正在上升。很多人以為:「我不會被騙。」但 AI 最大的危險,是它開始讓詐騙「不像詐騙」。包含 KPMG 在內的多家國際顧問機構,也開始將 Deepfake、AI 假訊息與生成式 AI 詐騙列為新型態企業風險。因為當 AI 能夠模仿語氣、聲音甚至影像後,人類辨識真假的難度也正在快速提高。

(資料來源:KPMG 解析 AI 帶來的 7 大風險)

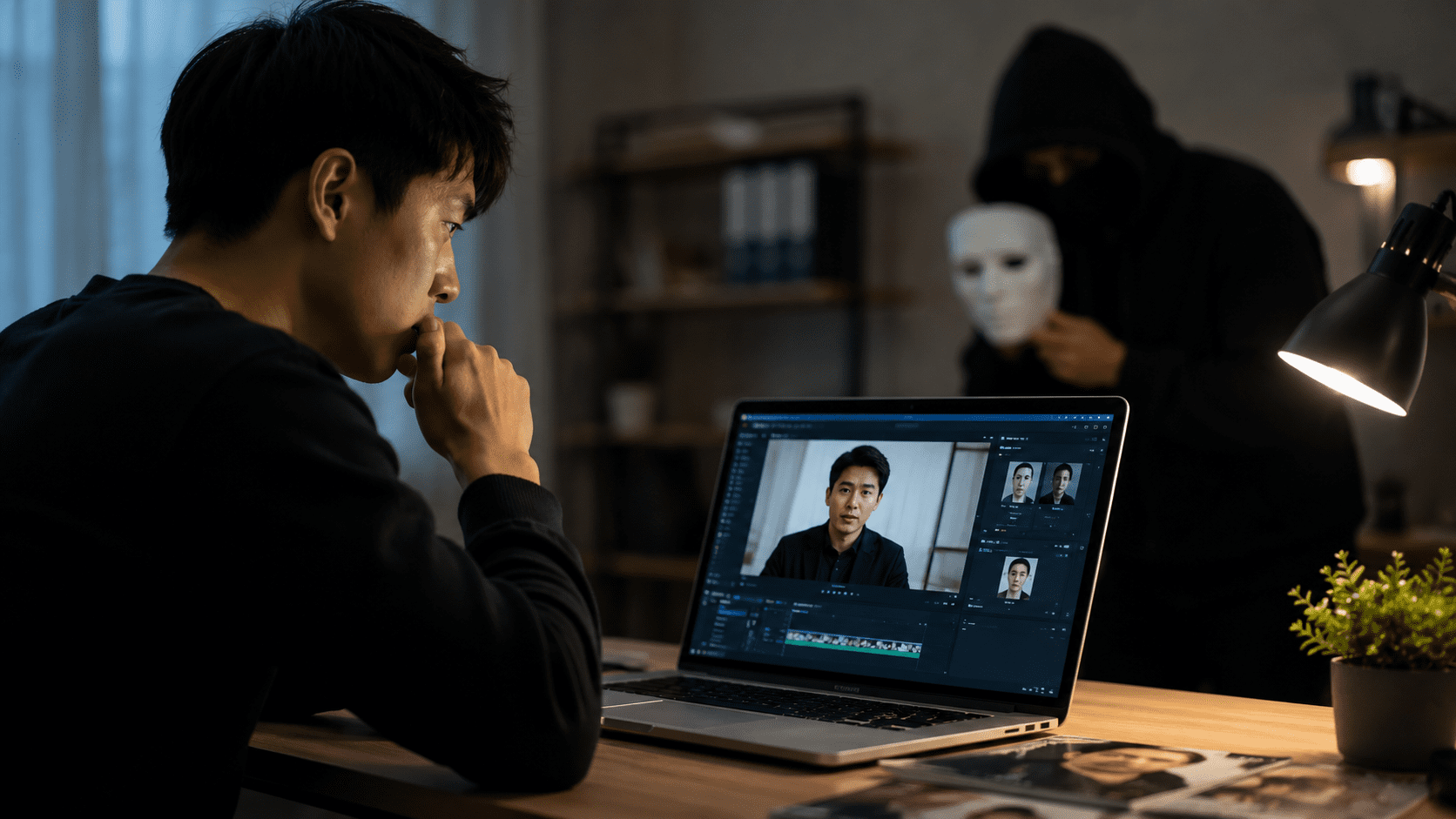

AI Deepfake 已進入企業 AI 資安風險

現在全球企業已開始出現:

- AI 假聲音

- AI 假視訊

- AI 假主管會議

- AI 假身份驗證

甚至已有企業因 Deepfake 視訊會議,造成巨額財務損失。未來幾年「你看到的,不一定是真的。」將成為 AI 資安常態。

未來密碼管理將進入「零信任時代」

AI 時代下,單靠密碼已經不夠。甚至許多人沒有注意到,部分 AI 相關瀏覽器外掛,本身也可能成為新的資料風險來源。有資安研究指出,一些 Chrome 擴充功能甚至能讀取使用者與 AI 工具之間的對話內容。

未來趨勢會大量轉向:

- MFA 多因素驗證

- Passkey 無密碼登入

- 生物辨識

- 行為驗證

- Zero Trust(零信任架構)

因為未來真正重要的,不只是「登入成功」,而是「這個人到底是不是真人。」

(資料來源:你裝的那個 Chrome 擴充功能,正在偷偷讀你跟 ChatGPT 的每一句話)

4. 最危險的事:人類開始過度相信 AI

AI 最大的風險,不是錯,而是「看起來很對」

很多人第一次使用生成式 AI 時,都會被震撼:

- 回答流暢

- 邏輯完整

- 語氣專業

- 速度驚人

但 AI 有個本質問題,它會「合理地胡說八道」。這也是所謂的:Hallucination(幻覺)。AI 可能:

- 編造不存在的資料

- 假造研究來源

- 誤判法規

- 提供錯誤醫療建議

- 生成錯誤程式碼

而真正危險的是,很多人會因為 AI 太像專家,而停止查證。這也是目前 AI 領域非常被重視的問題之一。許多 AI 研究者認為,人類一旦過度信任 AI,未來最大的風險可能不再只是資料外洩,而是錯誤資訊被大規模相信與傳播。

(延伸閱讀:統整 ChatGPT 的資安風險)

資訊安全,未來其實是「認知安全」

未來最重要的風險之一,不只是資料外洩。而是人類是否還保有判斷能力。因為 AI 正在改變:

- 人們相信資訊的方式

- 判讀真假的能力

- 決策習慣

- 思考深度

未來企業最危險的員工,不一定是不懂 AI 的人。而可能是「完全相信 AI 的人。」

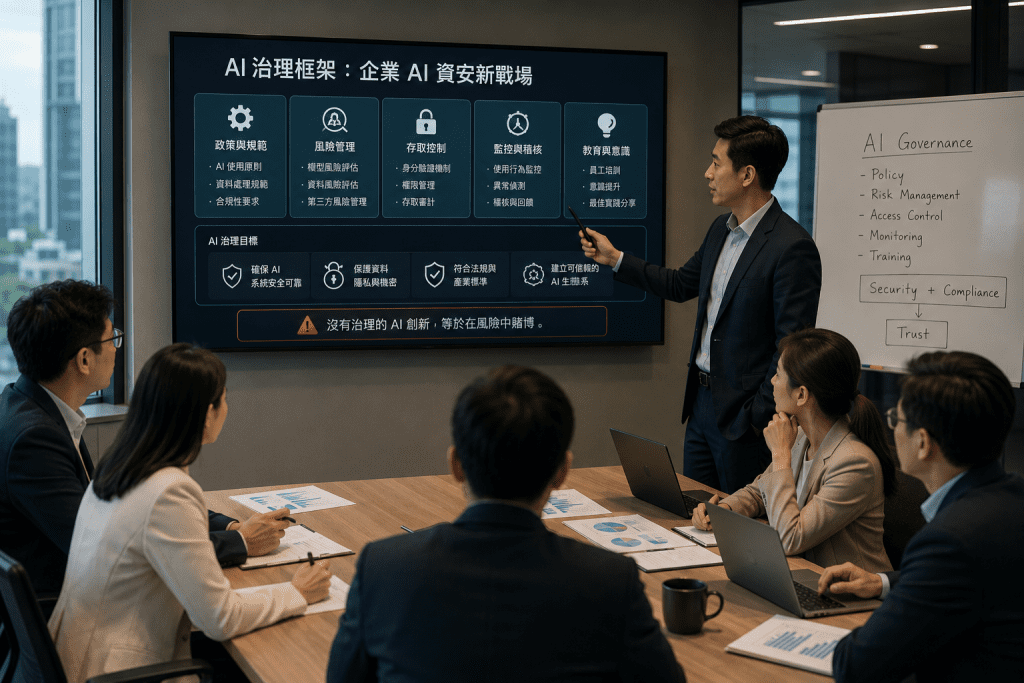

5. AI 治理將成企業資安新戰場

未來企業競爭,不只是 AI 能力,而是 AI 管理能力

現在很多公司都在導入 AI。但真正成熟的企業,開始問的是:

- 誰能使用 AI?

- 哪些資料能用?

- AI 結果誰負責?

- 如何稽核 AI?

- 如何避免偏誤?

- AI 決策能否追溯?

這就是 AI Governance(AI 治理)。

AI 治理,將成未來企業標配

未來大型企業會逐漸建立 AI 使用規範。例如:

- 禁止輸入個資

- 禁止上傳未公開資料

- 所有 AI 內容需人工複核

- AI 輸出需標示

- 敏感部門禁止外部 AI

未來真正安全的企業,不是「不用 AI」。而是「知道怎麼安全地使用 AI。」

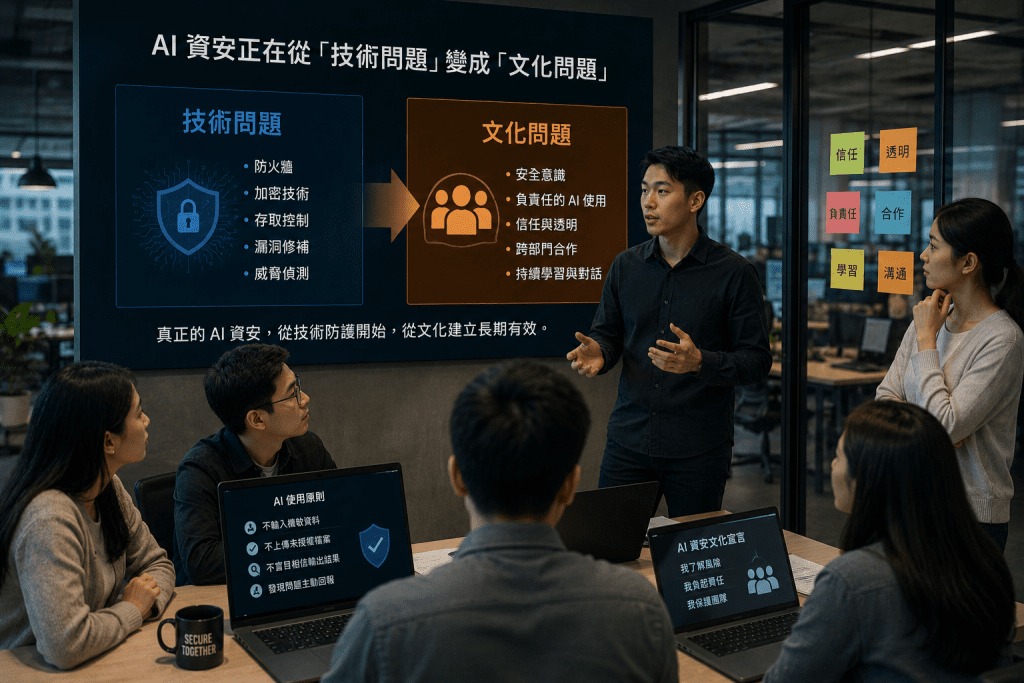

6. 資安正在從「技術問題」變成「文化問題」

真正的漏洞,通常不是系統,而是習慣

很多企業資安事故最後發現,不是因為駭客太強。而是:

- 員工亂傳檔案

- 密碼太簡單

- 共用帳號

- 隨便點連結

- 對 AI 過度信任

AI 時代更是如此。因為 AI 大幅降低了「犯錯門檻」。以前需要專業技術才能處理資料,現在任何人一句 Prompt 就能完成。但也因此,人人都可能誤觸風險。

未來最重要的是「資安素養」

未來企業真正需要訓練的,不只是 AI 技能。而是:

- AI 判讀能力

- Prompt 風險意識

- 資料邊界觀念

- AI 驗證能力

- Deepfake 辨識能力

未來 AI 素養,不再只是「會不會用 AI。」而是「知不知道什麼不能給 AI。」

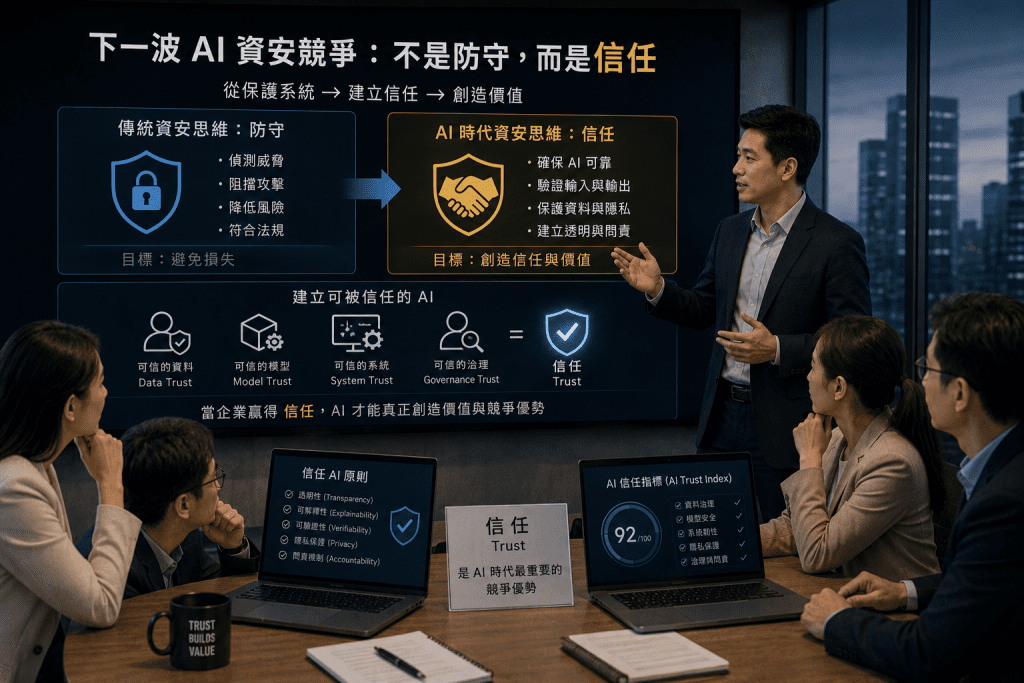

7. 下一波資安競爭:不是防守,而是信任

未來最值錢的,將是「可信 AI」

接下來幾年,全球 AI 發展會進入下一階段:Trustworthy AI(可信任 AI)。企業開始重視:

- AI 是否可追溯

- AI 是否透明

- AI 是否能解釋

- AI 是否安全

- AI 是否合規

因為未來真正的商業核心,不只是 AI 很強。而是「這個 AI 能不能被信任。」

資訊安全,其實是下一代的文明能力

很多人把資安看成技術問題。但從更長遠角度來看,它其實是人類如何與智慧系統共存的能力。AI 不會停止發展,真正重要的是,我們是否建立了足夠成熟的使用文化。

未來最危險的企業,不一定是沒有 AI 的企業。而可能是「大量使用 AI,卻沒有治理能力的企業。」

真正成熟的 AI 使用者,都懂得敬畏資料

AI 帶來的效率革命,已經無法逆轉。但越強大的工具,越需要邊界。未來真正專業的人,不是最會下 Prompt 的人。而是:

- 知道哪些資料不能給 AI

- 知道 AI 可能犯錯

- 知道 AI 不能完全信任

- 知道如何驗證 AI

- 知道如何建立安全文化

AI 時代的資訊安全,不再只是 IT 部門責任。而是每一位使用 AI 的人,都必須具備的新基本能力。

延伸閱讀:

中小企業不轉型就淘汰?掌握 4 大 AI 落地策略,讓員工效率翻倍、競爭力升級

2026 年 6 大 AI 發展趨勢,台灣中小企業如何用 AI 翻轉競爭力?

資安人科技網|生成式 AI 資安觀察